Dialogare con l’AI senza rischi. Le regole per cogliere i vantaggi

Quando rischi, errori e pregiudizi derivano dalla programmazione e dall’addestramento

Chi, al giorno d’oggi, non ha mai usato l’Intelligenza artificiale almeno una volta? Velocizza, rende tutto più facile: una specie di magia che risolve ogni problema e risponde come un oracolo ad ogni domanda.

Alcune criticità dell’AI le abbiamo ben presenti: per esempio, può dare ‘dipendenza’ e, facendoci perdere l’abitudine a farci domande e a faticare in prima persona, può farci perdere autonomia nelle scelte, nel giudizio e nell’espressione della creatività. Ci sono però anche altri rischi, meno evidenti. Ce li fa capire la storia di Joy Buolamwini, narrata anche nel documentario «Coded Bias».

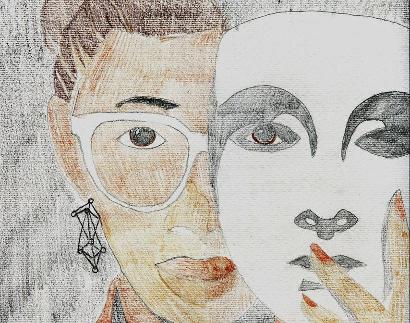

Giovane ricercatrice di informatica, nel 2018 è al lavoro ai sistemi di analisi delle espressioni facciali tramite AI del MIT Medialab, uno dei maggiori centri di ricerca al mondo. Testando i sistemi in prima persona, si accorge che qualcosa non funziona, perché le sue espressioni non vengono individuate adeguatamente. Il motivo? È donna e nera: i sistemi, creati da uomini bianchi, riconoscono bene chi ha le caratteristiche dei loro programmatori. Paradossalmente, il viso di Joy viene analizzato meglio quando indossa una maschera bianca, che aumenta il contrasto: questa diventa, per Joy, il simbolo della discriminazione digitale.

Alla luce della sua esperienza, la giovane ricercatrice fonda l’AJL (Algorithmic Justice League) che si batte per una AI più equa e più giusta, cercando di eliminare gli usi scorretti dell’AI.

La prima esigenza dell’organizzazione è far sì che tutti siano consapevoli di come funziona l’AI, dei suoi rischi e dei suoi difetti, e che ogni utente dia il consenso in modo consapevole per l’utilizzo dei propri dati. Ciò non è rimasto senza seguito: possiamo vedere come alcune idee sostenute dall’AJL siano presenti nelle recenti norme europee e italiane (l’AI Act-Regolamento UE 1689/2024 e la legge 132/2025), che suddividono i rischi dell’AI, in termini di equità e tutela dei diritti, in quattro livelli (rischio inaccettabile, alto, limitato e minimo). Inaccettabili sono, in particolare, le attività con carattere discriminatorio e intrusivo, soprattutto quando i dati sono rilevati in spazi pubblici.

Perché l’AI sia realmente equa, bisogna assicurarsi che abbia a disposizione dati completi, non solo quelli che rispecchiano la fisionomia e gli interessi di chi l’ha progettata.

Nessuno è immune dai pregiudizi, nemmeno le macchine, insomma: bisogna pensare a come combattere questa tendenza, che dagli umani rischia di passare anche alla macchina progettata per sembrare umana.

Abbiamo conosciuto la storia di Joy Buolamwini grazie ad una conferenza tenuta qualche settimana fa nella nostra scuola da Marco Montanari, filosofo e formatore, con il contributo di Aisa Impianti Spa. Tra le varie figure di donne innovatrici che ci sono state presentate, Joy ci ha colpito particolarmente perché è una persona dei nostri tempi, che affronta problemi per noi molto attuali. Figlia di uno scienziato e di un’artista, è nata in Canada nel 1989 ma ha vissuto anche in Ghana, Spagna, Inghilterra e Stati Uniti. Ha scelto di dedicarsi all’informatica ed è diventata una pioniera nello studio dei bias algoritmici, cioè di quegli errori dei sistemi di intelligenza artificiale che sono causati da dati di addestramento incompleti o pregiudiziali e che producono risultati distorti, discriminatori o non equi. Si definisce «poetessa del codice», recuperando, con questa immagine, un aspetto che forse spesso mettiamo in secondo piano riguardo all’arte, alla letteratura e alla poesia: i poeti evidenziano, in modo efficace e creativo, le storture e i difetti della società in cui vivono. Il mondo di oggi è plasmato dalla programmazione e dall’automazione e c’è bisogno di fare luce sul rischio che questi strumenti possano diffondere pregiudizi dannosi, soprattutto quando vengono utilizzati per prendere decisioni importanti per la vita e il futuro delle persone. Nel 2019 la rivista Fortune ha definito Joy «la coscienza della rivoluzione AI», proprio per come ha saputo portare alla luce la questione della garanzia dei diritti degli individui davanti all’AI, sempre più presente nelle nostre vite.

Alunni Muhammad Umar Ayubi, Pietro Badalamenti, Raffaele Bargigli, Giulia Bianchi, Maria Giulia Brunello Badiali, Giacomo Caprini, Lorenzo Ceccantini, Alessandro Faenzi, Umar Farooq, Neal Ferrario, Giulia Gaiti, Gaddo Gasperini, Leone Giovanni Giorgi, Vittorio Orso Giorgi, Muhammad Rahan Hussain, Davide Merlo, Matteo Meucci, Edoardo Neri, Mariagiulia Pastorelli, Esmeralda Ramagli, Laura Rasori, Lapo Ricci, Letizia Ricci, Olivia Sapino, Giovanni Maria Vardé Insegnanti Tutor: Valeria Capelli Preside Sandra Guidelli